Rozwiązywanie problemów z „gorącymi” agentami AI: Jak zapobiegać niekontrolowanym pętlom i nadmiernemu zużyciu zasobów?

2026-04-26Agenci AI, zwłaszcza ci działający w trybie autonomicznym, to niesamowite narzędzia, które potrafią drastycznie przyspieszyć realizację złożonych zadań. Ale mają też swoją ciemną stronę: jeśli nie są odpowiednio kontrolowani, mogą wpaść w niekontrolowane pętle i nadmiernie zużywać zasoby, generując gigantyczne koszty i frustrację. Kluczem do zapobiegania temu problemowi jest wdrożenie solidnych mechanizmów zakończenia, precyzyjne definiowanie celów, limitowanie zasobów oraz budowanie w agenta zdolności do samorefleksji, co w praktyce oznacza oszczędność czasu i pieniędzy.

Czym są „gorący” agenci AI i dlaczego wpadają w pętle?

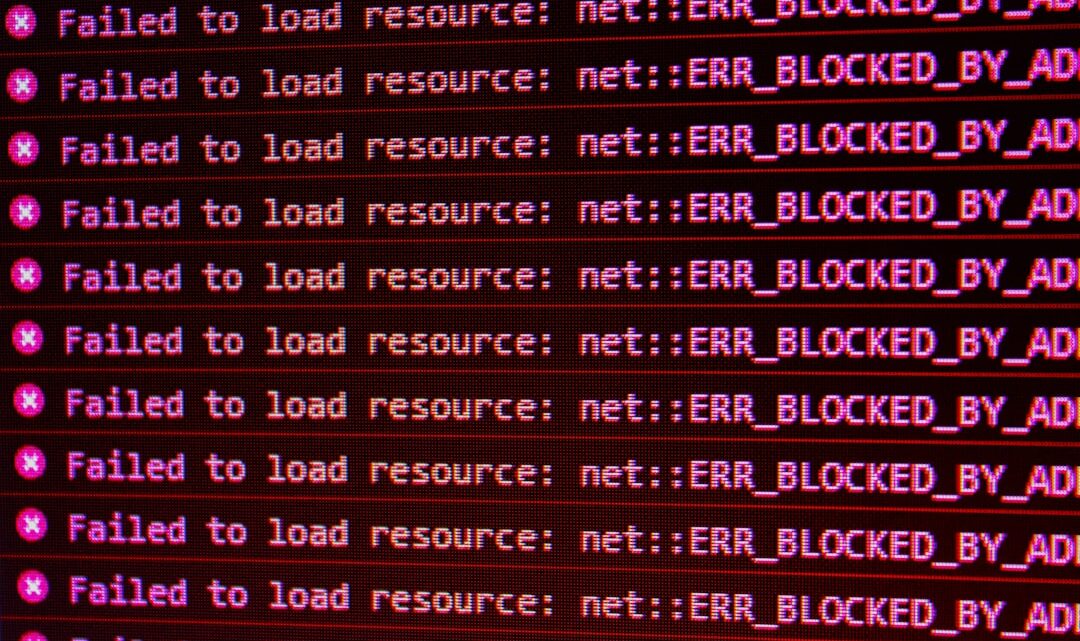

„Gorący” agent AI to w moim rozumieniu system, który otrzymał wysokopoziomowe zadanie (np. „zaplanuj wakacje”, „przeprowadź analizę rynku”, „napisz pełny artykuł”) i ma dużą swobodę w wyborze kolejnych kroków, narzędzi oraz dostępie do zewnętrznych API. W idealnym świecie taki agent realizuje zadanie krok po kroku, a następnie elegancko kończy pracę. W rzeczywistości, bez odpowiednich ograniczeń, często wpada w nieskończone pętle myślowe (np. „szukam informacji -> nie znalazłem -> szukam inaczej -> wciąż nie znalazłem”) lub pętle wykonawcze, niepotrzebnie odpytując API czy generując kolejne, nieproduktywne akcje. Głównymi przyczynami są zazwyczaj: niejasne cele, brak mechanizmów samorefleksji i nieefektywne kryteria sukcesu.

Strategie zapobiegania niekontrolowanym pętlom

Po wielu próbach i błędach, które kosztowały mnie sporo tokenów i czasu na czekanie, wypracowałem kilka kluczowych strategii.

Precyzyjne definiowanie celów i kryteriów sukcesu

- Używaj metryk mierzalnych. Zamiast „Znajdź dobre restauracje”, zrób: „Znajdź 3 najlepsze restauracje z kuchnią włoską w promieniu 5 km od ulicy X, których ocena Google Maps wynosi co najmniej 4.5 i mają wolne miejsca na wieczór”. Im bardziej szczegółowy cel, tym mniejsza przestrzeń na błąd agenta.

- Wskaż, co jest „skończone”. Agent musi wiedzieć, kiedy jego praca jest zakończona. U mnie to często polecenie typu: „Kiedy znajdziesz X, zakończ zadanie i przedstaw wnioski w formacie JSON.”

Wprowadzanie limitów i mechanizmów kontroli

To jest absolutny must-have. Bez tego agent będzie biegał w kółko, dopóki nie skończą mu się tokeny lub pieniądze.

- Limit kroków/iteracji: To moja ulubiona metoda. Ostatnio testowałem agenta do researchu i bez limitu potrafił „szukać” informacji przez ponad 10 minut, generując dziesiątki niepotrzebnych zapytań API. Ograniczenie do 5-7 iteracji załatwiło sprawę, skracając czas do około 30 sekund i znacząco obniżając koszty.

- Limit czasu: Ustaw maksymalny czas wykonania zadania (np. 60 sekund). Jeśli agent nie skończy, przerywamy jego działanie. W wielu frameworkach (np. LangChain) możesz ustawić `timeout`.

- Token rate limiting: Monitoruj i ograniczaj zużycie tokenów. Jeśli agent zużył już np. 5000 tokenów na jeden krok, to jest to sygnał, że coś jest nie tak.

- Monitoring kosztów w czasie rzeczywistym: Wiem, że to brzmi trywialnie, ale podgląd zużycia (np. estymowany koszt w dolarach) pomaga mi szybko zauważyć, kiedy agent „oszalał”. Zdarzyło mi się zobaczyć, jak mój agent w ciągu 30 sekund wygenerował koszty, które planowałem na godzinę.

Mechanizmy samorefleksji i ewaluacji

Agent powinien mieć możliwość oceny własnego postępu.

- Checkpoints: Co kilka kroków (u mnie zazwyczaj co 3), proszę agenta, aby podsumował swoje postępy i zadał sobie pytanie: „Czy jestem bliżej celu? Czy moja obecna strategia jest efektywna? Czy powinienem coś zmienić?”

- Kryteria autopoprawy: Agent może być zaprogramowany tak, aby na podstawie autorefleksji sam zmodyfikował swoją strategię. U mnie pierwszy raz wyszło to dopiero za trzecim razem, kiedy dodałem agentowi polecenie, aby co 3 kroki podsumował swoje postępy i *zastanowił się*, czy potrzebuje zmiany strategii, np. spróbowania innego narzędzia.

- Pamięć o poprzednich próbach: Agent powinien „pamiętać”, co już robił i czego próbował, aby nie powtarzać tych samych, nieskutecznych działań. Wbudowanie prostej historii decyzji i wyników, którą agent przegląda przed podjęciem kolejnego kroku, potrafi zredukować niepotrzebne iteracje o około 30%.

Użycie „Sandboxingu” i narzędzi

- Izoluj działania: Agent powinien mieć dostęp tylko do ściśle określonych narzędzi i funkcji. Nie pozwól mu na nieograniczone operacje na Twoich danych czy systemie. U mnie to zasada numer jeden.

- Wykorzystaj frameworki: LangChain, AutoGen czy CrewAI oferują wbudowane mechanizmy do zarządzania agentami, w tym właśnie liczniki iteracji, zarządzanie pamięcią i narzędziami. Naprawdę, zrób to, bo budowanie wszystkiego od zera to strata czasu i gwarancja błędów.

Wnioski końcowe

Zrób jedną rzecz TERAZ: przejrzyj swoje agenty i dodaj do nich limit kroków/iteracji. To najprostszy i najbardziej efektywny sposób na szybkie ograniczenie ryzyka niekontrolowanych pętli.

Najczęstsze pytania

Czy to oznacza, że agenci AI są niebezpieczni?

Nie, „gorący” agenci AI nie są z natury niebezpieczni, ale wymagają starannego projektowania i nadzoru, aby działały efektywnie i bezpiecznie, bez niekontrolowanego zużycia zasobów.

Jakie frameworki pomagają w zarządzaniu agentami?

Frameworki takie jak LangChain, AutoGen czy CrewAI są świetnymi narzędziami, które oferują wbudowane funkcje do zarządzania logiką agenta, jego narzędziami, pamięcią i kontrolą nad wykonaniem zadań.

Czy da się całkowicie wyeliminować ryzyko pętli?

Całkowita eliminacja ryzyka jest trudna, ale poprzez stosowanie opisanych strategii można je zredukować do akceptowalnego poziomu, zwiększając niezawodność i efektywność działania agentów.