Ochrona danych osobowych w erze AI: Jak bezpiecznie używać narzędzi takich jak ChatGPT i Gemini?

2026-04-02Cześć wszystkim fanom AI i tym, którzy dopiero zaczynają swoją przygodę z inteligentnymi asystentami! Dziś poruszymy niezwykle ważny temat: ochrona danych osobowych w erze AI. Jak bezpiecznie korzystać z narzędzi takich jak ChatGPT czy Gemini? Kluczem jest świadomość i odpowiedzialność. Aby bezpiecznie używać tych potężnych narzędzi, musisz zawsze zakładać, że wszystko, co wpisujesz, może zostać wykorzystane do trenowania modeli lub w inny sposób przetworzone. Nigdy nie udostępniaj danych wrażliwych, korzystaj z dostępnych funkcji prywatności, regularnie czyść historię czatów i zawsze weryfikuj, co robisz, z polityką prywatności danej usługi. Pamiętaj, Twoje dane to Twoja odpowiedzialność.

Dlaczego ochrona danych jest kluczowa w AI?

Narzędzia AI, takie jak ChatGPT czy Gemini, uczą się na ogromnych zbiorach danych. Część z nich pochodzi z publicznie dostępnych źródeł, ale wiele modeli wykorzystuje również dane wprowadzane przez użytkowników do dalszego doskonalenia. To właśnie tutaj leży ryzyko. Jeśli udostępnisz swoje dane osobowe (PII), poufne informacje firmowe czy jakiekolwiek inne wrażliwe dane, mogą one nie tylko zostać użyte w procesie trenowania i potencjalnie pojawić się w odpowiedziach dla innych użytkowników (choć dostawcy AI starają się temu zapobiegać), ale także stać się celem ataku w przypadku naruszenia bezpieczeństwa danych. Brak ostrożności może prowadzić do kradzieży tożsamości, ujawnienia tajemnic handlowych lub innych poważnych konsekwencji.

Praktyczne kroki do bezpiecznego korzystania z ChatGPT i Gemini

Oto konkretne porady, jak zminimalizować ryzyko podczas codziennego korzystania z AI:

Nigdy nie udostępniaj danych wrażliwych

- Traktuj AI jak publiczne forum: Zakładaj, że wszystko, co wpisujesz, może zostać przeczytane przez kogoś innego lub zostać częścią ogólnej wiedzy modelu.

- Unikaj PII: Nie wprowadzaj swojego imienia i nazwiska, adresu e-mail, numeru telefonu, numeru PESEL, danych karty kredytowej ani żadnych innych informacji, które mogą Cię bezpośrednio zidentyfikować.

- Nie udostępniaj danych firmowych: Nigdy nie wklejaj kodów źródłowych, strategii marketingowych, danych finansowych ani innych poufnych informacji biznesowych.

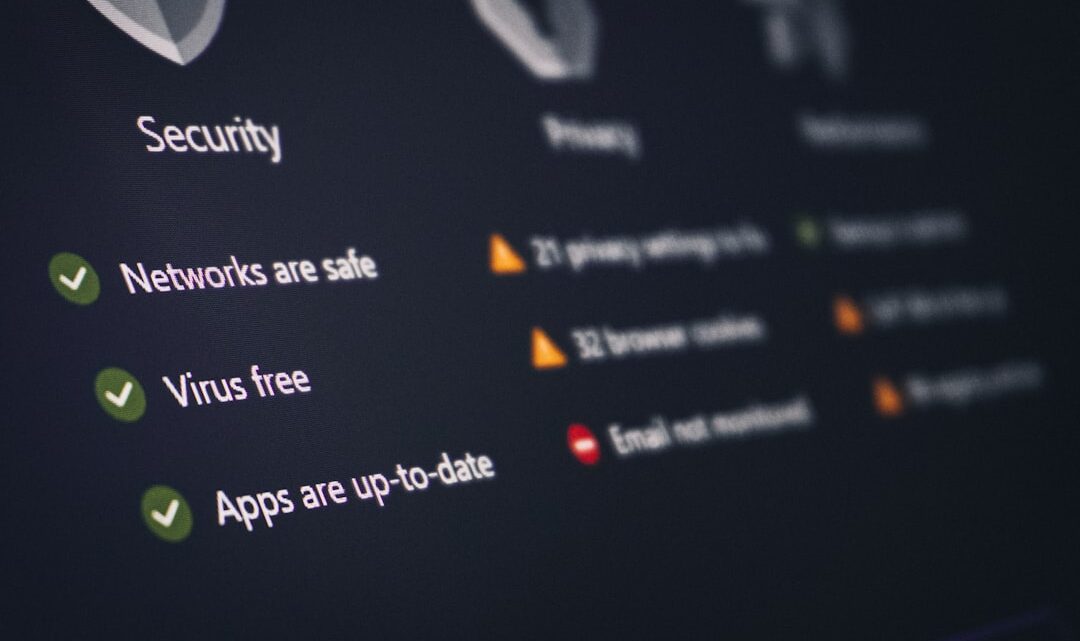

Korzystaj z trybów prywatności i ustawień

- ChatGPT: Wyłącz trenowanie na podstawie danych z czatów: W ustawieniach ChatGPT znajdziesz opcję „Chat history & training”. Wyłączenie jej zapobiegnie wykorzystaniu Twoich rozmów do trenowania modelu, choć historia czatów nadal będzie widoczna dla Ciebie.

- Gemini: Kontroluj aktywność: Google Gemini oferuje kontrolę aktywności, gdzie możesz wstrzymać zapisywanie aktywności w Gemini i zarządzać tym, co Google przechowuje. Regularnie sprawdzaj te ustawienia.

- Rozważ wersje Enterprise/Business: Jeśli Twoja firma intensywnie korzysta z AI, poszukaj rozwiązań klasy korporacyjnej (np. ChatGPT Enterprise), które oferują znacznie wyższy poziom ochrony danych i gwarancje prywatności.

Regularnie przeglądaj historię i usuwaj czaty

- Czyszczenie historii: Zarówno ChatGPT, jak i Gemini pozwalają na przeglądanie i usuwanie poszczególnych czatów lub całej historii. Regularnie usuwaj rozmowy, które mogły zawierać nawet minimalnie wrażliwe informacje. To redukuje ryzyko, że Twoje dane pozostaną w systemie dłużej niż to konieczne.

- Usuwaj na bieżąco: Jeśli wprowadziłeś przez przypadek coś wrażliwego, usuń ten konkretny czat natychmiast.

Zrozum politykę prywatności

- Przeczytanie to podstawa: Poświęć chwilę na przeczytanie polityki prywatności dla ChatGPT (OpenAI) i Gemini (Google). Zrozumiesz, jak dokładnie Twoje dane są gromadzone, przetwarzane i wykorzystywane. Wiesz, na co się zgadzasz.

Weryfikuj i ograniczaj

- Nie ufaj ślepo: AI to narzędzie. Zawsze weryfikuj fakty i informacje podane przez model, zwłaszcza w kontekście danych osobistych czy profesjonalnych.

- Ograniczaj zastosowanie: Nie używaj AI do zadań, które z natury wymagają przetwarzania szczególnie wrażliwych danych, chyba że masz do dyspozycji specjalne, zabezpieczone środowisko.

Co zrobić, gdy musisz przetwarzać dane wrażliwe?

Jeśli Twoja praca wymaga przetwarzania danych, które *muszą* zostać przeanalizowane przez AI, pomyśl o anonimizacji i pseudonimizacji. Zastąp bezpośrednie identyfikatory unikalnymi kodami, usuń wszystkie dane PII przed wprowadzeniem do modelu. Rozważ również dedykowane, wewnętrzne rozwiązania AI lub skorzystaj z profesjonalnych wersji narzędzi z odpowiednimi umowami o przetwarzaniu danych (DPA) i klauzulami poufności.

—

Najczęstsze pytania

Czy AI zapamiętuje moje dane?

Tak, wiele modeli AI może przechowywać i przetwarzać wprowadzone przez Ciebie dane do celów trenowania i ulepszania modelu, chyba że aktywnie wyłączysz tę opcję w ustawieniach prywatności.

Czy darmowe wersje AI są mniej bezpieczne?

Darmowe wersje zazwyczaj oferują mniejsze możliwości kontroli nad tym, jak Twoje dane są wykorzystywane do trenowania w porównaniu do płatnych rozwiązań enterprise, które gwarantują brak wykorzystania danych klientów do trenowania.

Co z danymi firmowymi?

W przypadku danych firmowych zawsze należy korzystać z wersji Enterprise/Business oferujących zaawansowane gwarancje prywatności i ochrony danych, a także dokładnie przestrzegać wewnętrznych polityk bezpieczeństwa firmy.